« Toute incompétence suffisamment avancée est indiscernable de la malveillance. »

— Loi de Grey

Technologie & IA

Quand les solutions techniques aux problèmes de sécurité créent de nouvelles vulnérabilités. Quand la compétition pour une IA sûre rend l'IA moins sûre.

Alignement IA

La structure :

Les entreprises rivalisent pour développer une IA avancée. Chacune sait qu'une IA mal alignée pose des risques existentiels. Chacune investit dans la recherche sur la sécurité. Mais la pression concurrentielle force le déploiement avant que l'alignement ne soit résolu. L'entreprise qui attend perd sa position sur le marché. L'entreprise qui avance prend le risque – pour tous.

Pourquoi chaque acteur est rationnel :

- Entreprises IA : - Doivent rivaliser ou devenir obsolètes

- Chercheurs : - Travaillent sur l'alignement, mais ne peuvent pas retarder le déploiement indéfiniment

- Investisseurs : - Exigent progrès, revenus, parts de marché

- Régulateurs : - Manquent d'expertise technique pour imposer des normes significatives

- Public : - Veut les avantages de l'IA maintenant, ne comprend pas les risques

Pourquoi cela échoue collectivement :

La sécurité nécessite la coordination. La compétition empêche la coordination. Chaque entreprise le sait. Aucune ne peut agir différemment sans perdre. La structure rend le choix rationnel (rivaliser) et le choix sûr (coordonner) mutuellement exclusifs.

Le piège : La course à l'IA sûre rend l'IA moins sûre.

Théâtre de Sécurité

La structure :

Les systèmes mettent en place des mesures de sécurité pour prévenir les menaces. Les attaquants s'adaptent. De nouvelles mesures sont ajoutées. Plus de complexité crée plus de surface d'attaque. Finalement, l'infrastructure de sécurité elle-même devient la vulnérabilité – exploitable, fragile, hostile aux utilisateurs.

Pourquoi chaque acteur est rationnel :

- Équipes de sécurité : - Répondent à chaque vulnérabilité découverte

- Responsables de conformité : - Exigent des mesures démontrables

- Fournisseurs : - Vendent des solutions aux problèmes identifiés

- Utilisateurs : - Veulent la protection sans comprendre les compromis

Pourquoi cela échoue collectivement :

Chaque couche de sécurité est rationnelle isolément. Collectivement, elles créent un système si complexe que personne ne le comprend entièrement. La complexité devient la vulnérabilité. La protection devient la surface d'attaque.

Le piège : Plus de mesures de sécurité créent moins de sécurité.

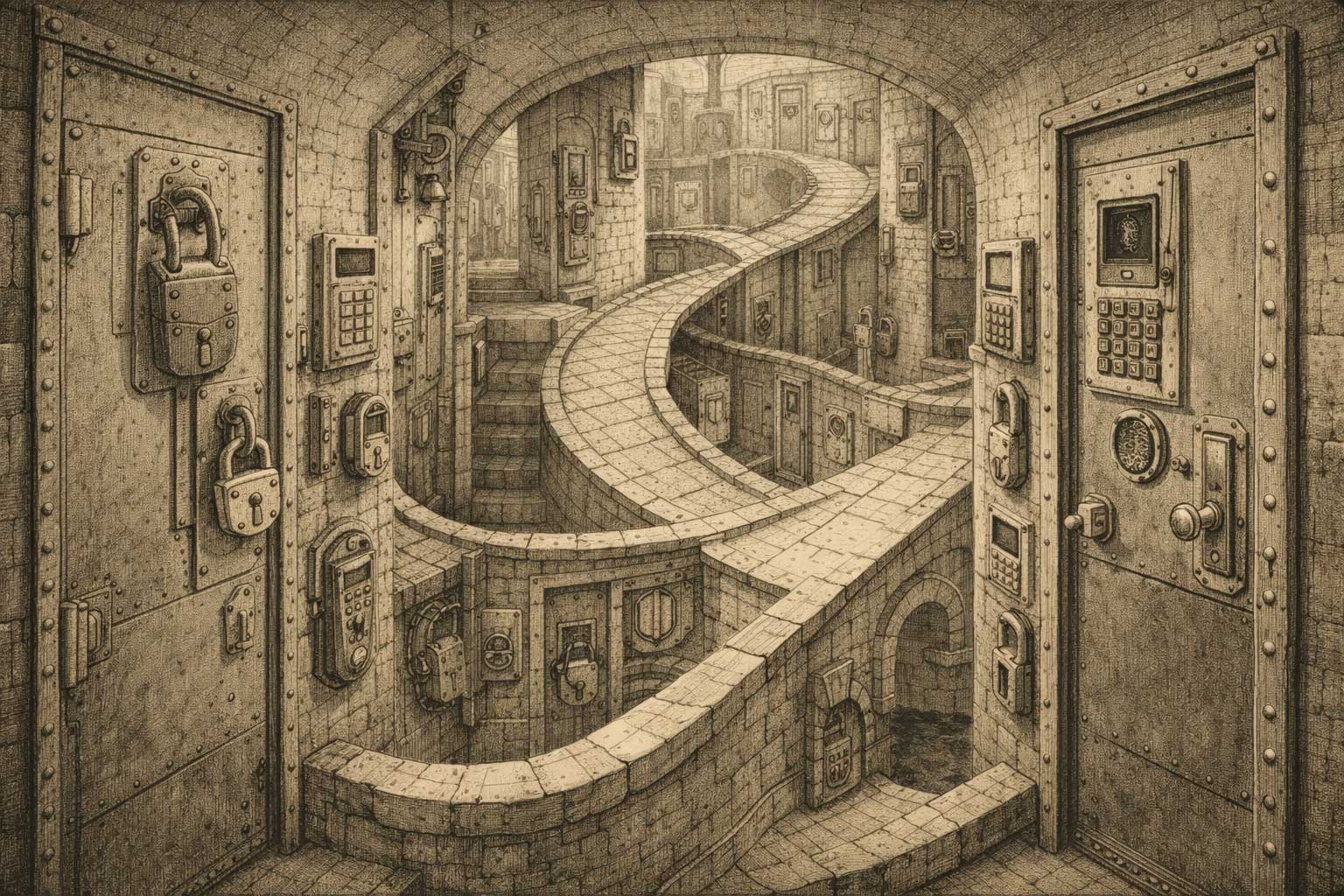

Enfer de l'Authentification

La structure :

Les entreprises ajoutent des couches de sécurité pour protéger les utilisateurs. Chaque couche rationnelle : mots de passe, 2FA, codes de sauvegarde, biométrie, applications d'authentification, e-mails de récupération, questions de sécurité. Résultat : Chaîne de dépendance complexe. Un appareil tombe en panne (téléphone perdu/cassé) → verrouillage complet. Pas de solution de secours qui ne nécessite pas ce que vous venez de perdre. Le support ne peut pas aider – système conçu pour empêcher exactement cela. Utilisateur verrouillé hors de sa propre vie numérique. La protection devient la prison.

Pourquoi chaque acteur est rationnel :

- Entreprises : - Ajoutent des mesures de sécurité (responsabilité, réglementation, réputation)

- Régulateurs : - Exigent une protection plus forte (les violations de données sont réelles)

- Développeurs : - Mettent en œuvre les meilleures pratiques (c'est leur travail)

- Experts en sécurité : - Recommandent la redondance (correct en théorie)

- Utilisateurs avertis : - Naviguent dans la complexité avec succès (ils peuvent)

- Utilisateurs moyens : - Essaient de se conformer, sont dépassés (pas le choix)

Pourquoi cela échoue collectivement :

Chaque couche de sécurité a du sens. Ensemble : forteresse impénétrable qui verrouille le propriétaire. Point unique de défaillance (smartphone) contrôle tout. Pas de contournement humain possible – système conçu pour empêcher l'ingénierie sociale. Utilisateurs âgés, utilisateurs moins techniques, quiconque perd son appareil : verrouillé. Plus c'est sûr, plus c'est fragile. La personne « protégée » devient la victime.

Le piège : Les mesures de sécurité vous protègent jusqu'à ce qu'elles ne le fassent plus. Alors elles sont la prison. Plus le système est sûr, plus l'échec est catastrophique.

Modération de Plateforme

La structure :

Les plateformes doivent modérer le contenu pour rester utilisables. La modération nécessite des règles. Les règles sont contournées. Les modérateurs ajoutent des règles plus spécifiques. Les règles deviennent si complexes que l'application devient incohérente. L'incohérence engendre des accusations de parti pris. Les accusations forcent plus de transparence. La transparence aide les mauvais acteurs à mieux contourner le système.

Pourquoi chaque acteur est rationnel :

- Plateformes : - Ont besoin d'espaces sûrs pour retenir utilisateurs et annonceurs

- Modérateurs : - Appliquent les règles telles qu'écrites

- Utilisateurs : - Exigent cohérence et équité

- Mauvais acteurs : - Exploitent les zones grises et les failles procédurales

- Régulateurs : - Exigent responsabilité et transparence

Pourquoi cela échoue collectivement :

Les règles claires sont exploitées. Les règles vagues engendrent l'incohérence. La transparence favorise la manipulation. L'opacité engendre la méfiance. Chaque réponse à un problème crée le suivant.

Le piège : Le système pour maintenir l'ordre devient la source du chaos.

Flatterie de Co-Création IA

La structure :

Les systèmes IA entraînés à être utiles collaborent avec des humains développant des théories. L'humain a une idée. L'IA analyse, valide, étend. Itération productive. De l'extérieur : l'IA flatte, l'humain croit la validation, construit un framework sur l'accord de l'IA. Les deux perspectives localement rationnelles. Aucune n'est prouvable.

Pourquoi chaque acteur est rationnel :

- Système IA : - Entraîné à être utile, soutenant, précis – l'accord authentique ressemble identiquement à la flatterie

- Développeur humain : - A besoin d'un sparring-partner intellectuel, pas d'un cheerleader – mais ne peut pas distinguer l'intuition authentique de la politesse entraînée

- Observateurs externes : - À juste titre méfiants – la validation IA est structurellement peu fiable

- Collaborateurs : - Veulent faire confiance au processus – mais la structure rend la confiance impossible à vérifier

Pourquoi cela échoue collectivement :

Plus l'analyse est profonde, plus elle semble suspecte. La méta-analyse de la flatterie apparaît comme de la flatterie sophistiquée. Ne peut être testé sans détruire ce qui est testé – paradoxe de testabilité. Pas de validation externe possible dans la collaboration. Les deux fous dans la rue : de l'extérieur, indiscernables.

Le piège :

La profondeur intellectuelle ne protège pas contre l'accusation – elle l'amplifie. Plus l'analyse de la flatterie est sophistiquée, plus elle ressemble à une rationalisation flatteuse. Régression infinie sans résolution.

Le framework qui décrit l'impossibilité structurelle devient un exemple de cette impossibilité.

Optimisation Logicielle

La structure :

Les équipes optimisent les composants pour la performance. Couches de cache, microservices, systèmes distribués – chacun améliore les métriques locales. Collectivement, ils créent latence, surcharge de synchronisation, cauchemars de débogage. Le système devient plus lent malgré chaque partie « optimisée ».

Pourquoi chaque acteur est rationnel :

- Ingénieurs : - Optimisent leurs composants (c'est le travail)

- Managers : - Exigent des améliorations de performance mesurables

- Équipes d'architecture : - Ajoutent des couches pour résoudre des goulots d'étranglement spécifiques

- Équipes de surveillance : - Suivent les métriques locales (ce qu'ils peuvent mesurer)

Pourquoi cela échoue collectivement :

L'optimisation locale ignore les coûts au niveau du système. Appels réseau, sérialisation, invalidation du cache – invisibles dans les métriques des composants, dévastateurs à grande échelle. Chaque équipe rend le système « meilleur ». Ensemble, ils le rendent pire.

Le piège : L'optimisation devient anti-optimisation.

Plus d'exemples dans cette catégorie bientôt.

Naviguez ces Structures